Taalas: AI 모델을 실리콘에 고정하다

AI 인프라는 지난 몇 년간 범용 GPU를 중심으로 급격히 성장해왔습니다. 대형 데이터센터에 고성능 GPU를 수천 장씩 묶어 모델을 학습하고 추론을 처리하는 구조가 표준이 되었습니다. 그러나 추론 수요가 폭증하면서 비용, 전력, 지연(latency) 문제가 점점 더 구조적인 한계로 드러나고 있습니다.

이 지점에서 Taalas는 전혀 다른 방향을 제시했습니다.

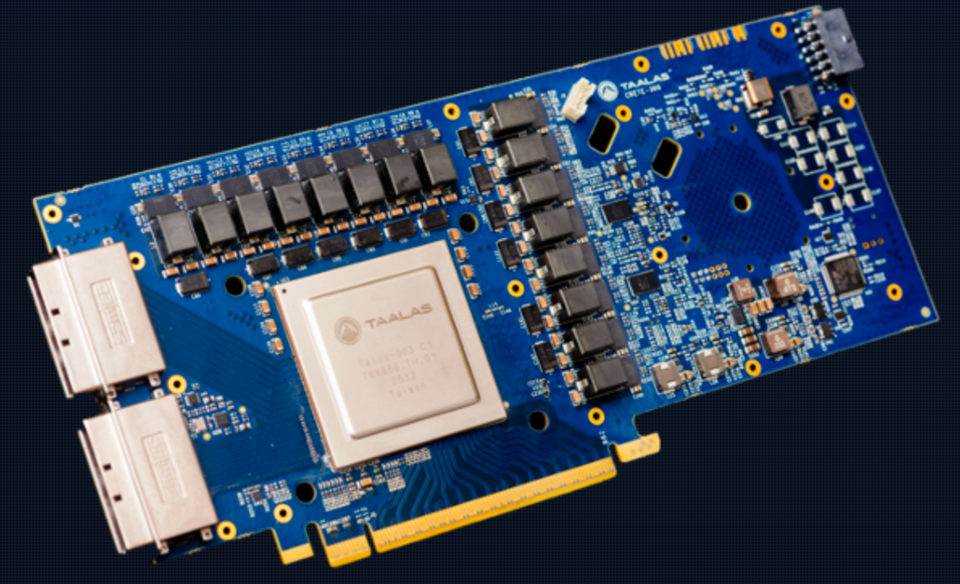

범용 하드웨어 위에서 모델을 실행하는 대신, 모델 자체를 하드웨어로 구현한 ASIC을 발표한 것입니다. 소프트웨어로 동작하던 LLM을 아예 실리콘에 고정해버리는 접근입니다.

왜 Llama 3.1 8B였을까

Taalas가 첫 타깃으로 선택한 모델은 Llama 3.1 8B였습니다. 이 선택은 상징적이면서도 전략적입니다.

첫째, 오픈소스 기반으로 상업적 활용이 가능합니다. 라이선스 제약이 적기 때문에 칩에 직접 구현하는 데 현실적인 장벽이 낮습니다.

둘째, 실제 프로덕션 환경에서 널리 사용되는 범용 LLM입니다. 단순한 연구용 모델이 아니라, 기업 서비스와 애플리케이션에서 반복적으로 호출되는 모델입니다.

셋째, 70B 이상의 초대형 모델과 달리 배포 단위가 현실적입니다. 데이터센터가 아닌 엣지 또는 제한된 인프라에서도 운용 가능성이 있습니다.

즉, “가장 거대한 모델”이 아니라 “가장 많이 반복 실행되는 모델”을 선택한 것입니다. Taalas의 가정은 분명합니다. 대부분의 추론 수요는 소수의 인기 모델로 수렴할 것이라는 판단입니다. 연구 영역에서는 모델이 빠르게 교체되지만, 프로덕션 환경에서는 검증된 모델이 장기간 사용됩니다.

성능과 수치

Taalas는 해당 ASIC이 약 17,000 tokens/sec의 처리 성능을 달성했다고 밝혔습니다. 기존 GPU 대비 10배 빠르고, 비용은 20배 낮으며, 전력 효율은 10배 개선되었다고 주장했습니다.

조직 규모도 눈에 띕니다. 팀은 약 24명, 초기 개발 비용은 약 3천만 달러, 총 투자 유치는 2억 달러 이상입니다.

또한 기존 수개월 이상 걸리던 칩 설계 과정을 약 60일 수준으로 단축했다고 밝혔습니다. 설계 자동화와 모델-하드웨어 변환 파이프라인이 핵심이라는 설명입니다.

구조적 차이: 메모리 병목의 제거

LLM 추론의 핵심 병목은 연산 자체보다 메모리 이동에 있습니다. GPU는 대규모 HBM 메모리에서 가중치를 반복적으로 읽어와 연산합니다. 이 과정이 전력 소모와 지연의 상당 부분을 차지합니다. Taalas의 접근은 이 병목을 구조적으로 제거하는 것입니다.

HBM, 3D 스택, 고속 I/O, 액체 냉각 등 복잡한 요소를 배제하고, 스토리지와 연산을 단일 칩에 통합했습니다. 모델을 실리콘에 고정함으로써 데이터 이동을 최소화하고 전력 구조를 단순화했다는 설명입니다. 이는 범용 GPU의 유연성을 포기하는 대신, 특정 모델에 대한 효율을 극대화하는 전략입니다.

전략적 베팅

이 선택은 단순한 기술 실험이 아닙니다. 명확한 전략적 베팅입니다. GPU는 무엇이든 실행할 수 있습니다. 대신 비쌉니다. ASIC은 하나만 잘합니다. 대신 압도적으로 싸고 빠를 수 있습니다.

만약 추론 시장이 몇 개의 인기 모델 중심으로 재편된다면, 모델 전용 칩은 강력한 경제성을 가질 수 있습니다. 반대로 모델 트렌드가 빠르게 바뀐다면, 하드웨어는 빠르게 구식이 될 위험도 있습니다.

인프라의 다음 단계일까

현재 AI 인프라는 범용 GPU 중심 구조 위에서 확장되고 있습니다. 그러나 추론 트래픽이 일상 서비스에 깊이 들어올수록 비용과 전력은 더 이상 무시할 수 없는 요소가 됩니다.

Taalas의 시도는 하나의 질문을 던집니다.

모델이 안정되고 반복된다면, 굳이 범용 하드웨어 위에서 계속 실행해야 할까요?

유연성을 일부 포기하고 경제성을 극대화하는 전략.

이 접근이 성공한다면, AI 인프라의 설계 방식 자체가 다시 정의될 가능성도 있습니다.